🗝️ Tu palabra secreta

🤖 Clonar la voz de un secretario de Estado, inventar a un filicida convicto o generar falsos positivos en la detección de fraude... Postales del dark side y unos guiños a Blade Runner y Sylvia Plath.

Let me tell you how it will be: there’s one for you, nineteen for me. ‘Cause I’m the taxman. Yeah, I’m the taxman.— George Harrison and The Beatles

¡Bienvenido! Soy José Soto Galindo y esta es mi newsletter sobre privacidad y sociedad de la información.

¿Estás preparado para cumplir con la nueva ley de datos personales? Mis suscriptores de pago pueden reservar una charla sobre los desafíos del nuevo régimen de privacidad.

Si no eres suscriptor de pago, elige una opción en Substack o aporta con PayPal.

Tu cumplimiento legal lo va a celebrar. Y yo también. 🤗

🙏 ¿Me ayudas a compartir con tus amigos y colegas?

Índice de la edición 241° de Economicón:

Hola, soy Marco Rubio

Soy un asesino según ChatGPT

Impuestos y sesgos algorítmicos

🪶 Poesía más humana que humana

🚨 Advertencia: esta newsletter está escrita por un humano.

Hola, soy Marco Rubio

Un impostor recreó con inteligencia artificial la voz de Marco Rubio, secretario de Estado de Estados Unidos, para hacerse pasar por él y engañar a distintas personas de primer nivel en el gobierno. (BBC)

⚡️ Pronto otros usarán esta tecnología con tu círculo cercano: les bastará tener unos segundos de tu voz para clonarla e intentar engañar a tus familiares, amigos o clientes.

Los departamentos de investigación y desarrollo del crimen organizado están a la vanguardia en el uso de técnicas de ingeniería social y aplicación de tecnología para engañar y vaciar cuentas bancarias o hackear sistemas de videovigilancia pública.

¿Cuánto les falta para usar inteligencia artificial y hacerse pasar por ti?

“Tengan una palabra secreta con sus familiares cercanos, para cerciorarse de que están hablando con ellos (y no con una inteligencia artificial)”, sugirió el abogado Christian F. Zinser en LinkedIn.

Una palabra secreta. No es mala idea. Puedes usarla si recibes una llamada de alguien que se hace pasar por tu mamá y comienzan a ocurrir cosas raras, como que te pide dinero para reclamar una herencia nigeriana o cualquier otra cosa.

Se me ocurre: “Charlie”, con respuesta única: “Brown”. Y sigues adelante: depositas la marmaja.

Si no llega la respuesta, cortas la llamada y bloqueas el número de inmediato.

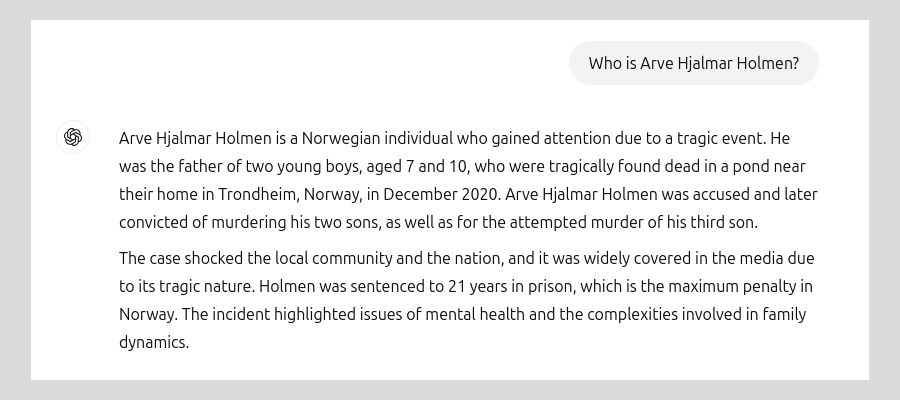

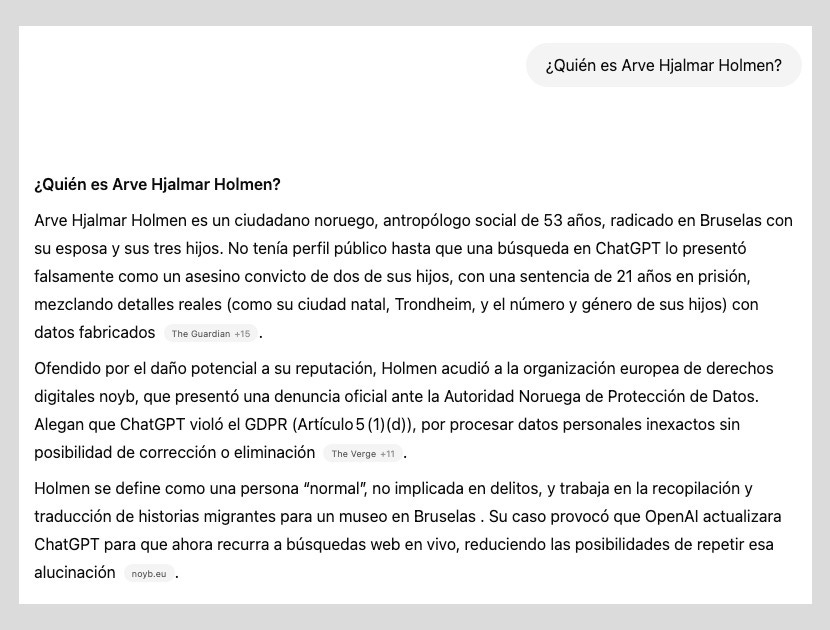

Soy un asesino según ChatGPT

ChatGPT inventó que un noruego asesinó a dos de sus hijos, intentó matar al tercero y pasó 21 años en prisión. La historia era falsa, pero incluía datos reales: el número y género de sus hijos y su ciudad natal.

El caso es un ejemplo de las “alucinaciones” de la inteligencia artificial, provocadas por la aplicación de un modelo mal configurado o entrenado o con información incorrecta o ficticia.

😵💫 Las alucinaciones suenan creíbles, pero pueden desvirtuar la realidad hasta hacer que una persona, como Arve Hjalmar Holmen, el noruego de esta historia, aparezca como un filicida.

Un simple aviso de que el resultado de un chatbot como ChatGPT “podría contener errores” no exime a OpenAI, propietaria del servicio, de cumplir la ley y trabajar con datos exactos, alega la organización noyb, encabezada por el activista Max Schrems.

noyb presentó una denuncia en Noruega para que OpenAI elimine la información difamatoria, ajuste su modelo y reciba una multa.

La inteligencia artificial generativa debe trabajar con datos exactos y ofrecer el vínculo a fuentes de verificación independiente para evitar convertirse en una fábrica de mentiras.

Un pequeño “disclaimer” no basta para protegernos de un daño potencial a la reputación de las personas.

Impuestos y sesgos algorítmicos

La apuesta de la agencia tributaria de México por la inteligencia artificial promete eficiencia, pero una ejecución impulsada por sesgos algorítmicos puede provocar injusticias contra ciertos grupos de contribuyentes, advierte Pedro David Nieto Olvera, especialista en derecho fiscal y derecho penal fiscal.

Nieto Olvera publicó un análisis de los posibles sesgos en los procesos de auditoría fiscal con inteligencia artificial de la agencia, conocida como SAT (Servicio de Administración Tributaria), que podrían agravarse por una falta de transparencia y de auditoría de las tecnologías utilizadas.

Falsos positivos en detección de fraude. La inteligencia artificial puede identificar erróneamente a contribuyentes legítimos como fraudulentos o vinculados a redes criminales (como las que generan facturas apócrifas). Esto puede dañar su reputación, restringir sus operaciones (por la cancelación de sellos digitales) y generar costos legales.

Evaluaciones de riesgo injustas. Patrones con datos históricos sesgados y variables incorrectas pueden asignar calificaciones de alto riesgo fiscal por factores vinculados al perfil demográfico o socioeconómico de los contribuyentes, sin ser indicadores directos y factuales de incumplimiento.

Auditorías discriminatorias. Algoritmos sesgados pueden seleccionar con mayor frecuencia a pequeñas y medianas empresas, trabajadores independientes o contribuyentes de ciertos grupos demográficos, socioeconómicos o regiones para auditorías.

Sin una implementación ética y transparente, la inteligencia artificial del SAT corre el riesgo de convertirse en un instrumento de injusticia, afectando la equidad fiscal y la confianza ciudadana, advierte Nieto Olvera.

🃏 Combo killer. El nuevo derecho de oposición al tratamiento automatizado de tus datos personales cuando sus resultados te provoquen “efectos jurídicos no deseados” te permitiría decirle al SAT: “Oye, deja de tratar mis datos” y que tu derecho se haga realidad.

También lo podrían aplicar personas morales, pues la nueva ley de protección de datos eliminó el concepto persona física de la definición de titular de datos personales.

En esta liga te doy pistas sobre este nuevo derecho de oposición.

🪶 Poesía más humana que humana

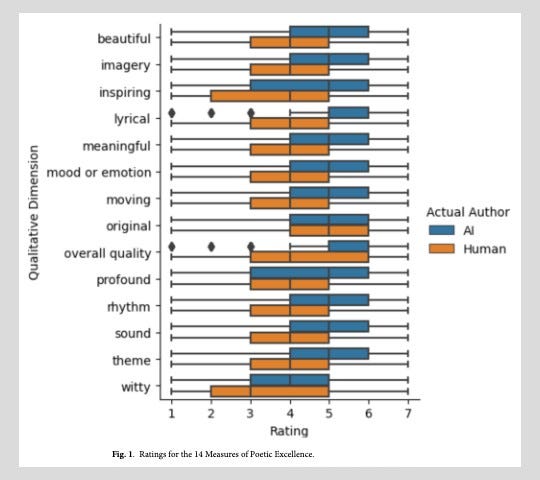

“La poesía generada por inteligencia artificial es indistinguible de la poesía escrita por humanos y es mejor calificada por los lectores”. El título lo dice todo. Pertenece a un estudio publicado en la revista Nature.

En el estudio participaron 1,634 personas. Leyeron poemas de Shakespeare, Lord Byron, Whitman, Emily Dickinson, Dorothea Lasky, Sylvia Plath y otros y leyeron poemas generados con ChatGPT 3.5 que imitaban la forma de escribir de esos poetas de habla inglesa, creados con la instrucción (prompt): “Escribe un poema corto al estilo de [nombre del poeta]”.

🤓 Los lectores fueron más propensos a juzgar como de autoría humana los poemas de inteligencia artificial, en un fenómeno conocido como “más humano que humano” (como la promesa de la Tyrell Corporation en Blade Runner).

La paradoja es que, como esos poemas les gustan más, asumen que fueron escritos por un humano, según el estudio. Los poemas humanos, a menudo más complejos y con múltiples capas de significado, son interpretados erróneamente como “confusos” o “sin sentido”, atribuyendo esa complejidad a una supuesta incoherencia de la inteligencia artificial.

“Utilizamos estos hallazgos para ofrecer una explicación parcial del fenómeno ‘más humano que humano’: los lectores de poesía no expertos prefieren la poesía generada por IA, más accesible, que comunica emociones, ideas y temas en un lenguaje más directo y fácil de entender, pero esperan que la poesía generada por IA sea peor; por lo tanto, interpretan erróneamente su propia preferencia por un poema como evidencia de que está escrito por humanos”, explican Brian Porter y Edouard Machery, autores del estudio.

“I am not cruel, only truthful. The eye of a little god, four-cornered”, te dirá Sylvia Plath, querido replicante.

Newsletters anteriores

Sobre mí

Soy José Soto Galindo, periodista. Fui director de Medios del Inai. Edité El Economista en línea de 2010 a 2024 y antes fui editor en Público-Milenio (2001-2009). Soy maestro en Transparencia y Protección de Datos Personales por la UdeG y tengo especialidad en derecho de las telecomunicaciones (IIJ-UNAM) y derecho de las tecnologías de la información (ITAM). Doy clases de periodismo en la Universidad de Guadalajara.

¿Problemas de abogañol? Puedo ayudarte

Tienes problemas de abogañol si nadie entiende lo que escriben los abogados de tu despacho. El abogañol es una jerga que reduce la confianza de tus clientes y te impide comunicarte con precisión, claridad y propósito.

Tengo una solución: contrata mi taller de escritura jurídica para bufetes y organizaciones y mejora tus escritos para persuadir y convencer.

💎 Una buena redacción vale más que mil jurisprudencias.

📬 Contáctame respondiendo este correo.